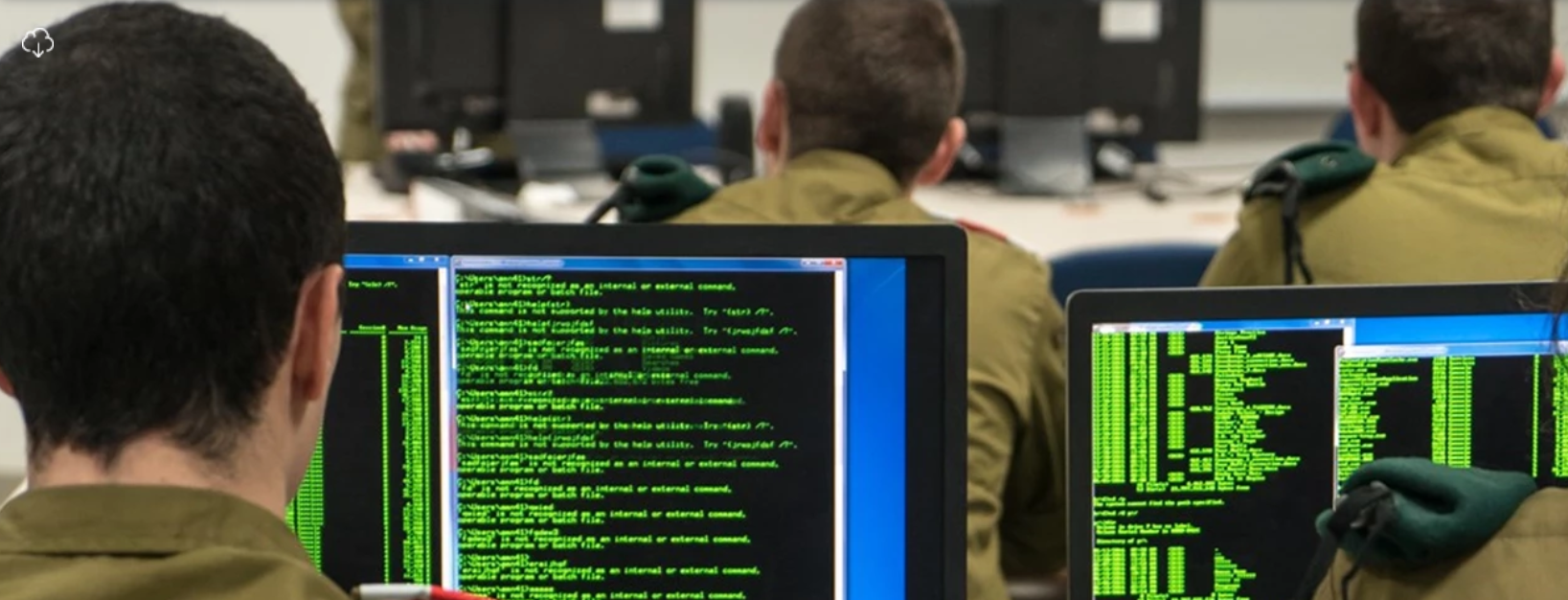

עבודה של שעות – בדקות ספורות | דיווח: צה”ל עושה שימוש נרחב ב-AI בעזה

בעקבות המתקפה של חמאס ב-7 באוקטובר 2023, צה”ל פתח במתקפה רחבת היקף בעזה, שהתבססה על מאגר מודיעין מקיף. המאגר הזה, שנקרא בעגה הישראלית “בנק מטרות”, כלל פרטים מדויקים על כתובות, מנהרות ותשתיות חיוניות של ארגון הטרור חמאס.

בכתבה מדהימה שפורסמה היום (שני) ב’וושינגטון פוסט’, נחשף כלי הבינה המלאכותית החדשני שעשה בו שימוש צה”ל, במטרה לאתר מטרות טרור נוספות ולהכות את האויב.

כשמאגר המטרות הראשוני התדלדל, צה”ל החל להשתמש בכלי בינה מלאכותית מתקדם בשם “הבשורה” כדי לייצר מטרות נוספות במהירות. שני גורמים המעורים בפעולה הסבירו ל’פוסט’ שהשימוש בכלים אלו אפשר לצבא לשמור על קצב הלחימה.

כלי הבינה המלאכותית, שפותחו במסגרת תוכנית צבאית בת עשור, הפכו למרכיב מרכזי במבצעי המודיעין של צה”ל.

אמנם, לצד ההישגים, התוכנית עוררה ויכוחים פנימיים בצבא עוד לפני האירועים בעזה. גורמים צבאיים בכירים תהו האם המודיעין שנאסף על ידי AI נבדק כראוי והאם ההתמקדות בטכנולוגיה פגעה בכישורים המסורתיים של אנליסטים אנושיים. חלקם טענו שהמערכות תרמו להעלאת מספר הנפגעים האזרחיים, אחרים בירכו על הכלי שמאתר קיני טרור במהירות ובאיכות שמוח אנושי אינו מסוגל לאתר לפי ממצאים מודיעיניים, בטח לא במהירות של בינה מלאכותית.

צה”ל הגיב לטענות על שימוש בטכנולוגיה המסכנת חיים לטענת המבקרים, בכך שהכלים שיפרו את הדיוק במתקפות, תוך הקטנת הנזק הנלווה. צה”ל הדגיש כי כל מטרה עוברת בדיקה של קצינים בכירים לפני שהיא מאושרת. עם זאת, דוחות פנימיים ומומחים ששוחחו עם ה’פוסט’ הביעו ספקות בנוגע לדיוק הכלים הללו, במיוחד בטיפול במידע בערבית וניתוח מילות סלנג.

אחד הכלים, בשם “לבנדר”, מעריך את הסיכוי שפרט מסוים הוא חבר בארגון טרור. באמצעות אלגוריתמים, ניתן לזהות שינויים עדינים בצילומי לוויין, כגון בור של משגר רקטות. תהליכים שבעבר ארכו שבועות מתקצרים כעת לדקות ספורות.

לכאורה, השיטה היא פשוטה יחסית. “מלמדים” את הבינה המלאכותית איך נראה בור שיגור של רקטות, והמכונה מאתרת כאלה למאות תוך זמן שיא.

גורמים בצה”ל דחו את הביקורת ואמרו שהמערכות החדשות מבטיחות עליונות טכנולוגית החיונית להישרדות המדינה. אך המעבר לטכנולוגיה, כולל חיזוק תפקידם של מהנדסים וצמצום אנשי שפה ומומחים מסורתיים, עורר שינוי תרבותי ביחידות המודיעין, כמו 8200. גורמים לשעבר ביחידה הביעו חשש מכך שההתמקדות בטכנולוגיה החלישה את יכולות החשיבה הביקורתית.

מפקדי צה”ל לשעבר תיארו כיצד שינויים אלו השפיעו על מוכנות הצבא. האשמות על התלות בטכנולוגיה הועלו לאחר הכשלים במניעת המתקפה ב-7 באוקטובר, כשהמודיעין לא הצליח להתריע על האיום. על פי טענות, הדגש על AI הקשה על אנליסטים להציג אזהרות למפקדים בכירים. במילים אחרות, ייתכן שמערכת הבינה המלאכותית שנכנסה כאמור לשימוש עוד לפני השבעה באוקטובר, מנעה מצה”ל לזהות איומים באמצעים אנושיים בגלל חוסר תרגול.

מערכת “הבשורה” פותחה כחלק משיפוץ מקיף של יחידת 8200, בראשותו של יוסי שריאל, אומר ה’פוסט’. הכלי מתבסס על מאות אלגוריתמים החוזים מיקומים פוטנציאליים של מטרות, תוך הצלבת נתונים מתקשורת, צילומי לוויין ורשתות חברתיות. אולם, חלק מהמנהיגים בצה”ל הזהירו מפני שימוש מופרז בכלים אלו על חשבון יכולות אנושיות מסורתיות.

בשנים האחרונות, הדגש על בינה מלאכותית הביא לשינוי מהותי במבנה היחידה, כולל פיתוח מאגר נתונים מרכזי המכונה “הבריכה”. מאגר זה מאחד מידע מודיעיני ממגוון מקורות, מה שמאפשר לחיילים לנתח כמויות עצומות של נתונים בצורה יעילה. יחד עם זאת, תחקירים העלו סוגיות בנוגע לאמינות המידע ולמגבלות המערכות הטכנולוגיות, במיוחד בכל הקשור להבדלה בין מחבלים לאזרחים.

על רקע זה, משרד המשפטים הבינלאומי בהאג החל לבדוק האשמות על הפרות חוק בינלאומי בלחימה בעזה. ההסתמכות על מערכות AI במלחמות עתידיות עשויה לעורר דיון עולמי נרחב על תפקידה של הטכנולוגיה בלחימה והשפעתה על חיי אדם. בעוד הביקורת גוברת, ישראל מתמודדת עם השאלה כיצד לשלב בין חדשנות טכנולוגית לשמירה על ערכים מוסריים ונורמות בינלאומיות, לצד שמירה על כשירות אנליסטית עבור חיילי וקציני יחידות המודיעין.

Post Comment